본 게시물은 네이버 부스트코스 주재걸 교수님의 '인공지능을 위한 선형대수' 강의를 듣고 요약하였습니다.

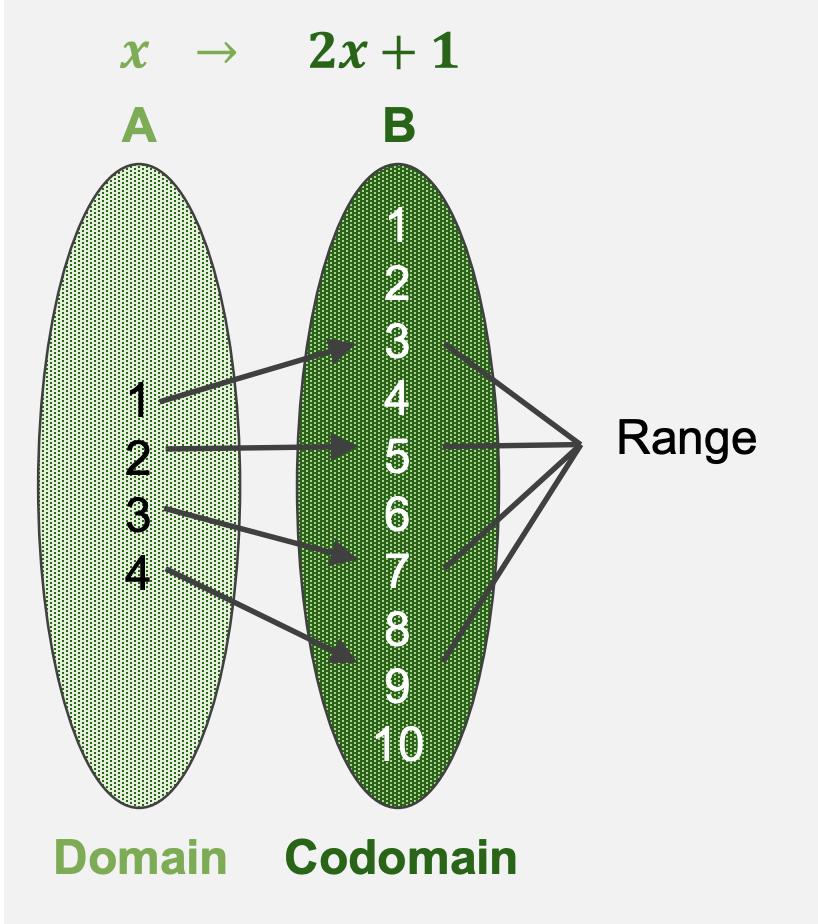

Linear Transformation

: Transformation, Mapping, Function ... 등으로 표현할 수 있음.

- Domain (정의역) : x의 모든 값

- Co-domain (공역) : y의 모든 값 (output의 집합)

- Range (치역) : 정의역에 대응하는 함수 값

- Image (함수의 상) : output

정의 : T(mapping / function)이 linear 하다고 할 때, 모든 $u, v$ 에 대해서 $T(cu + dv) = cT(u) + dT(v)$ 를 만족하면 선형 변환이라고 한다. (= 덧셈 성질과 스칼라 곱에 대한 성질을 만족해야 함)

즉, vector를 뽑아서 linear transformation을 한 것과, 각각 해서 더한 것의 합이 같아야 함.

- Basis Term 까지 포함된 경우, 선형 결합이라고 부르지 않음.

- 상수를 input의 한 dimension으로서 포함하게 되면, 어떤 bias도 없는 형태의 상수 Term으로 생각할 수 있음.

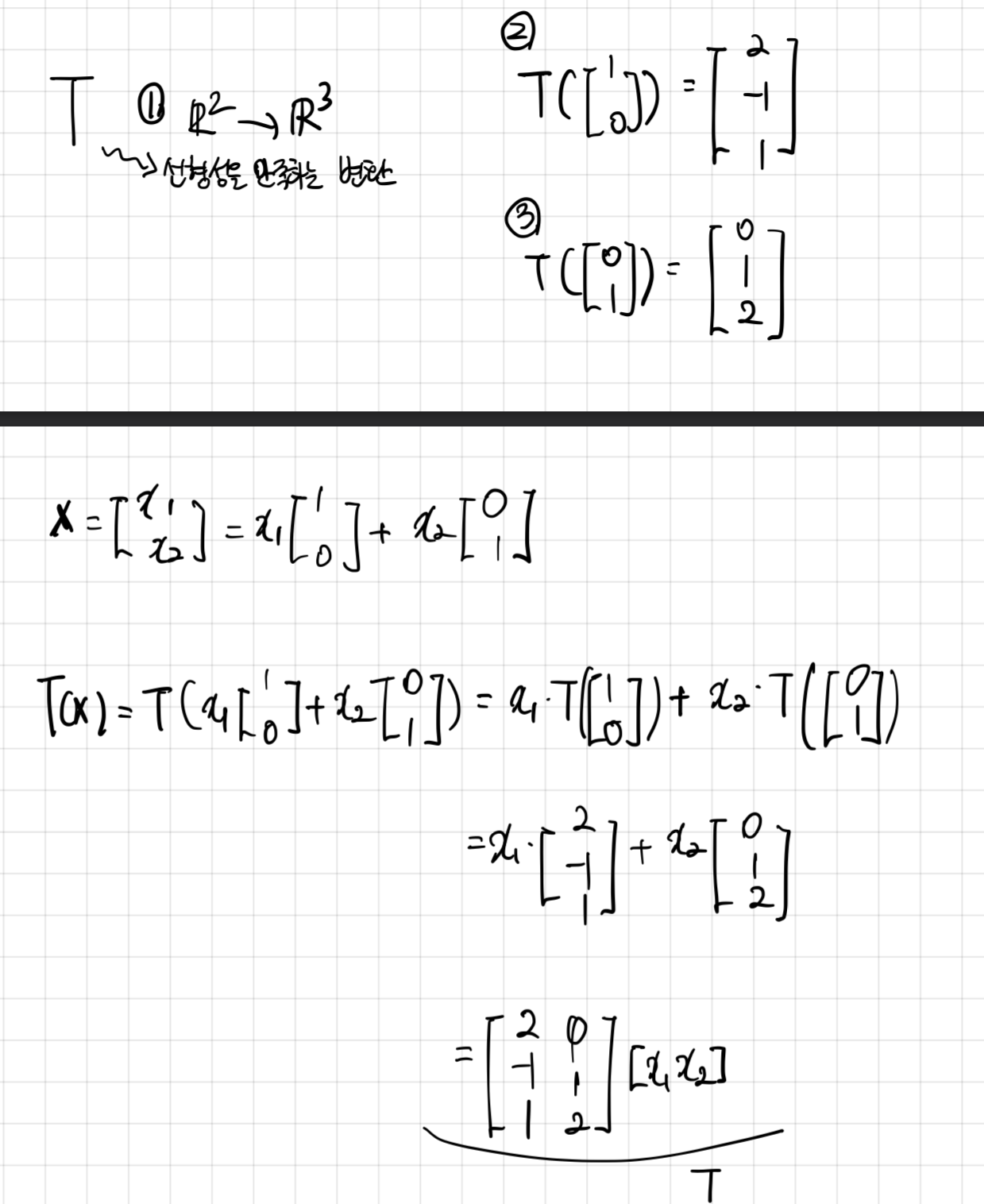

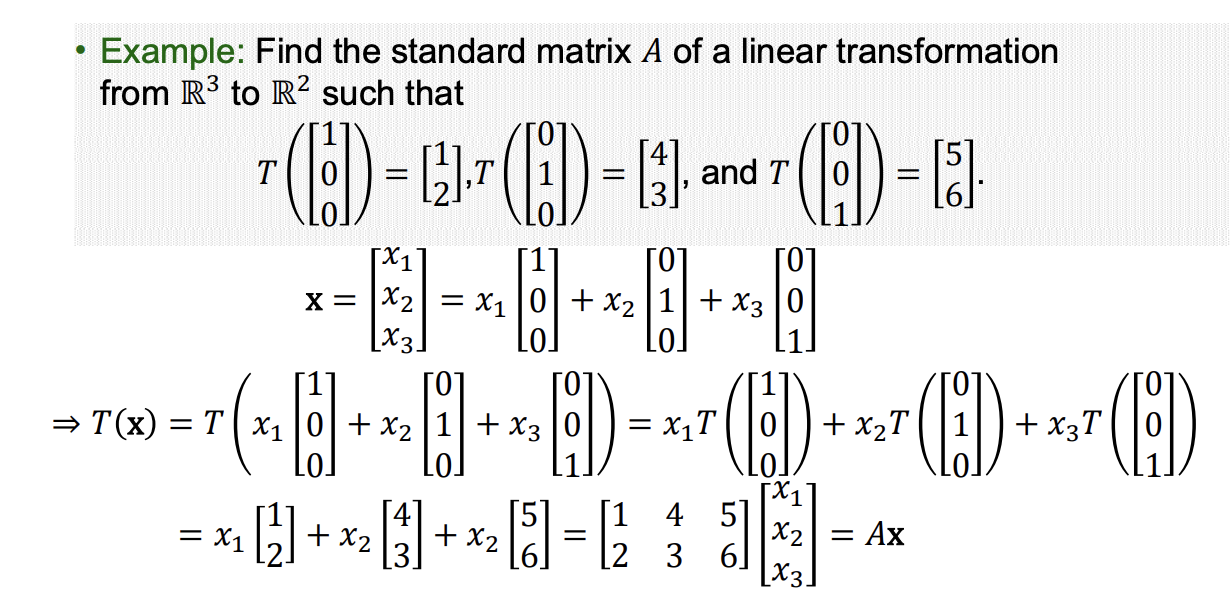

Matrix of linear transformation

: 선형성을 만족하는 변환 → 행렬과 주어진 입력 vector의 곱으로 나타낼 수 있음.

- $T : R^n → R^m$ 이 선형 변환이라고 한다면, $T(x) = Ax$ 에서, $A$는 입력 vector의 standard matrix가 된다. ( = linear transformation T의 standard matrix라고 함)

Linear transformation with Neural Network

https://colah.github.io/posts/2014-03-NN-Manifolds-Topology/

- n개의 dimension을 가진 Matrix를 vector 형태로 변경해줌

Affine Layer in Neural Network (FC layer와 유사)

: affine 변환을 기반으로 한 신경망 레이어를 지칭함. Linear transformation (입력에 대한 가중치의 합) 후 바이어스를 추가한 형태. (따라서 Linear 함을 만족하지 않음. - 동차성을 만족하지 않기 때문에)

'딥러닝 기초 > 수학..' 카테고리의 다른 글

| [선형 대수] Basis & Dimension (0) | 2024.03.02 |

|---|---|

| [선형 대수] Linear Combination & Span (0) | 2024.01.18 |

| [선형 대수] 선형 대수 기초 (1) | 2024.01.10 |